Jidoka

Preparando una clase de Gestión Adaptativa de Proyectos encontré un término que no recordaba hace años. Y no pude evitar detenerme. Describe mejor que cualquier concepto nuevo lo que estamos viviendo con la IA.

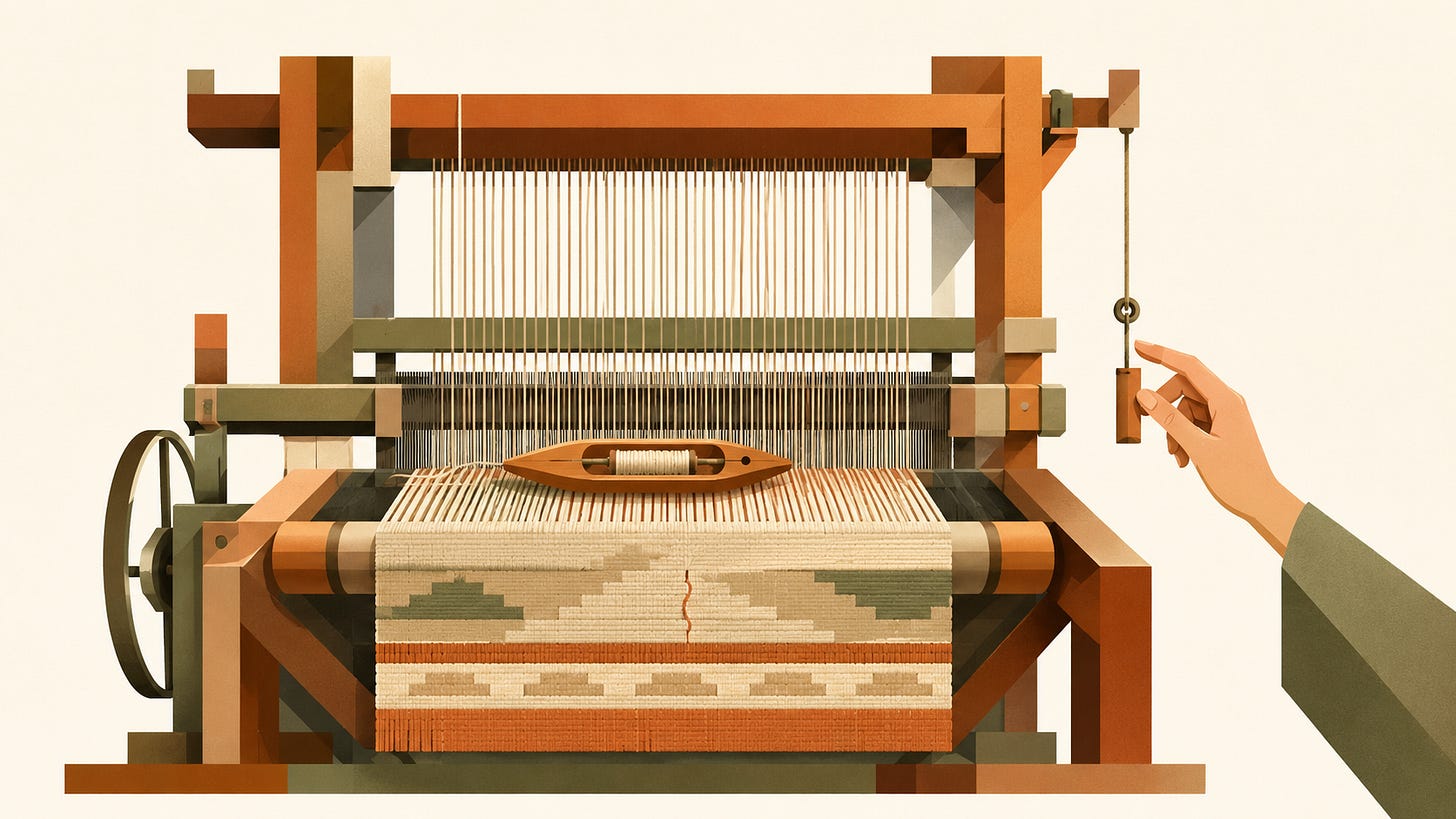

Sakichi Toyoda no se preguntó cómo hacer más tela más rápido. Se preguntó qué pasaba cuando el hilo se rompía y nadie lo notaba a tiempo.

La respuesta fue inesperada: diseñar la máquina para que se detenga sola cuando algo sale mal. No producir más rápido. Producir sin defectos que se acumulan en silencio.

A eso lo llamaron jidoka. Automatización con toque humano.

Y la distinción que construyeron encima es la que importa hoy. El proceso tiene cuatro pasos: detectar la anomalía, parar, corregir lo inmediato, investigar la causa raíz.

Los dos primeros los puede hacer la máquina. Los dos últimos no.

No es un detalle semántico. Es una declaración de arquitectura.

Dónde vive la inteligencia real en el sistema.

Hoy estamos construyendo herramientas que detectan con una precisión que ningún humano alcanzará.

Leen señales que no vemos, procesan variables que nos abruman, reconocen anomalías en milisegundos.

En eso, la máquina gana sin discusión.

Pero cuando la línea se detiene, alguien tiene que decidir qué significa.

¿Es un defecto real o una excepción legítima? ¿Paramos o ajustamos? ¿Lo que el modelo llama “riesgo” es riesgo en este contexto, con estos clientes, con esta estrategia?

Ese juicio no está en los datos.

El problema no es que las organizaciones confíen demasiado en la IA. Es que muchas instalan la detección sin que nadie sepa qué hacer con lo que detectan. Tienen el cordón. Pero nadie sabe cuándo jalarlo, ni qué hacer después.

Jidoka no era desconfianza hacia las máquinas. Era respeto por lo que las máquinas no pueden hacer.

¿Sabemos dónde está ese límite en nuestra organización?